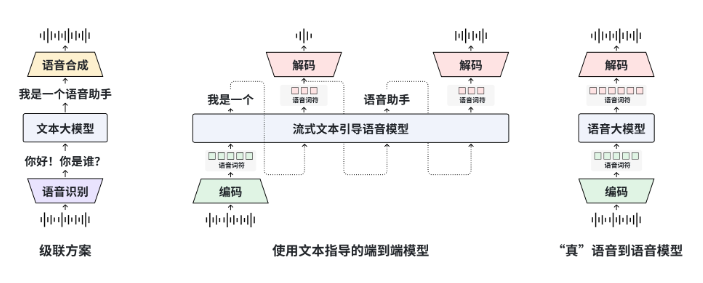

复旦大学MOSS团队推出MOSS-Speech,首次实现端到端Speech-to-Speech对话,模型已上线Hugging Face Demo并同步开源权重与代码。MOSS-Speech采用“层拆分”架构:冻结原MOSS文本大模型参数,新增语音理解、语义对齐与神经声码器三层,可一次性完成语音问答、情绪模仿与笑声生成,无需ASR→LLM→TTS三段流水线。

评测显示,MOSS-Speech在ZeroSpeech2025无文本语音任务中WER降至4.1%,情感识别准确率91.2%,均优于Meta的SpeechGPT与Google AudioLM;中文口语测试主观MOS分达4.6,接近真人录音4.8。项目提供48kHz超采样版与16kHz轻量版,后者可在单张RTX4090实时推理,延迟<300ms,适合移动端部署。

团队透露,下一步将开源“语音控制版”MOSS-Speech-Ctrl,支持通过语音指令动态调整语速、音色与情感强度,预计2026年Q1发布。MOSS-Speech已开放商用许可,开发者可通过GitHub获取训练与微调脚本,在本地完成私有声音克隆与角色语音化。

内容来源:AIbase基地

-

广告合作

-

QQ群号:4114653