Stable Diffusion类型:人工智能

简介:基于AI的绘画生成工具,主要用于根据文本描述生成详细图像。

- 不会安装环境

- 不知道 Prompt 怎么写

- 看不懂各种参数

- 模型太多不知道如何选择

- ControlNet 不会用

- 显存爆炸、生成失败

本篇教程将从零开始,详细介绍 Stable Diffusion 的安装、参数、提示词、ControlNet、模型使用等内容,帮助新手快速入门。

一、Stable Diffusion 是什么?

Stable Diffusion 是一个开源 AI 绘画模型,可以通过文字描述自动生成图片。

它本质上属于一种“扩散模型(Diffusion Model)”,通过不断降噪的方式,从随机噪点中一步步生成符合提示词的图像。

目前 Stable Diffusion 已广泛应用于:

- 动漫插画

- 人物写真

- 游戏原画

- UI 设计

- 建筑概念图

- 电商产品图

- AI 摄影

- 短视频素材制作

相比 Midjourney 等在线平台,Stable Diffusion 最大的优势是:

- 可本地运行

- 生成数量不限

- 可自由训练模型

- 支持大量插件扩展

- 玩法自由度极高

目前最常见的本地 WebUI 项目是 AUTOMATIC1111 WebUI。

项目地址:https://github.com/AUTOMATIC1111/stable-diffusion-webui

二、Stable Diffusion 硬件要求

Stable Diffusion 对硬件配置有一定要求,尤其是显卡性能。

| 硬件 |

推荐配置 |

| 显卡 |

NVIDIA RTX 系列 |

| 显存 |

6GB 起步,推荐 12GB+ |

| 内存 |

16GB 以上 |

| 硬盘 |

60GB 以上剩余空间 |

| CPU |

i5/R5 以上即可 |

为什么推荐 NVIDIA 显卡?

因为 Stable Diffusion 主要依赖 CUDA 加速,而 CUDA 是 NVIDIA 独家的 GPU 运算架构。

虽然 AMD 显卡目前也已有支持,但:

- 兼容性相对较差

- 安装复杂

- 插件支持不完整

- 生成速度通常慢于 NVIDIA

显存不足怎么办?

如果显存较低,可以:

- 降低图片尺寸

- 关闭高清修复

- 减少 LoRA 数量

- 开启 Low VRAM 模式

- 使用 xFormers 优化

一般来说:

- 6GB 显存:适合基础文生图

- 8GB 显存:基本够用

- 12GB+ 显存:体验最佳

三、Stable Diffusion 环境部署教程

方法一:手动部署(推荐进阶用户)

1、安装 Python

Stable Diffusion 依赖 Python 环境运行。

推荐安装:

Python 3.10

下载地址:https://www.python.org/downloads/

安装时务必勾选:

Add Python to PATH

否则后续可能无法识别 Python 环境。

2、安装 Git

Git 用于下载和更新 WebUI 项目。

下载地址:https://git-scm.com/

3、下载 Stable Diffusion WebUI

按下 Win + R 输入:

cmd

然后执行:

cd PATH_TO_CLONE git clone https://github.com/AUTOMATIC1111/stable-diffusion-webui.git

其中:

PATH_TO_CLONE

替换成你的安装目录。

例如:

cd D:\AI

4、下载模型

Stable Diffusion 必须配合模型使用,否则无法生成图片。

推荐模型网站:

- Civitai

- Hugging Face

- LiblibAI

模型下载后放入:

models/Stable-diffusion

5、启动 WebUI

双击:

webui-user.bat

首次启动会自动下载安装:

- PyTorch

- xFormers

- 依赖组件

- 运行环境

首次安装时间可能较长。

启动成功后浏览器打开:

http://127.0.0.1:7860

即可进入 Stable Diffusion WebUI。

6、如何更新 WebUI?

cd PATH_TO_CLONE git pull

即可更新到最新版本。

方法二:整合包安装(推荐新手)

如果觉得手动部署过于复杂,可以直接使用整合包。

常见整合包包括:

优点:

- 解压即用

- 自动安装环境

- 内置模型管理

- 支持一键更新

- 适合新手快速上手

建议开启 xFormers,可明显降低显存占用并提升生成速度。

四、Stable Diffusion WebUI 界面介绍

首次进入 WebUI 后,最常见的界面包括:

- txt2img(文生图)

- img2img(图生图)

- Extras(放大修复)

- PNG Info(读取参数)

- Extensions(插件)

- Settings(设置)

其中最常用的是:

- txt2img:通过文字生成图片

- img2img:通过图片二次创作

五、文生图基础教程

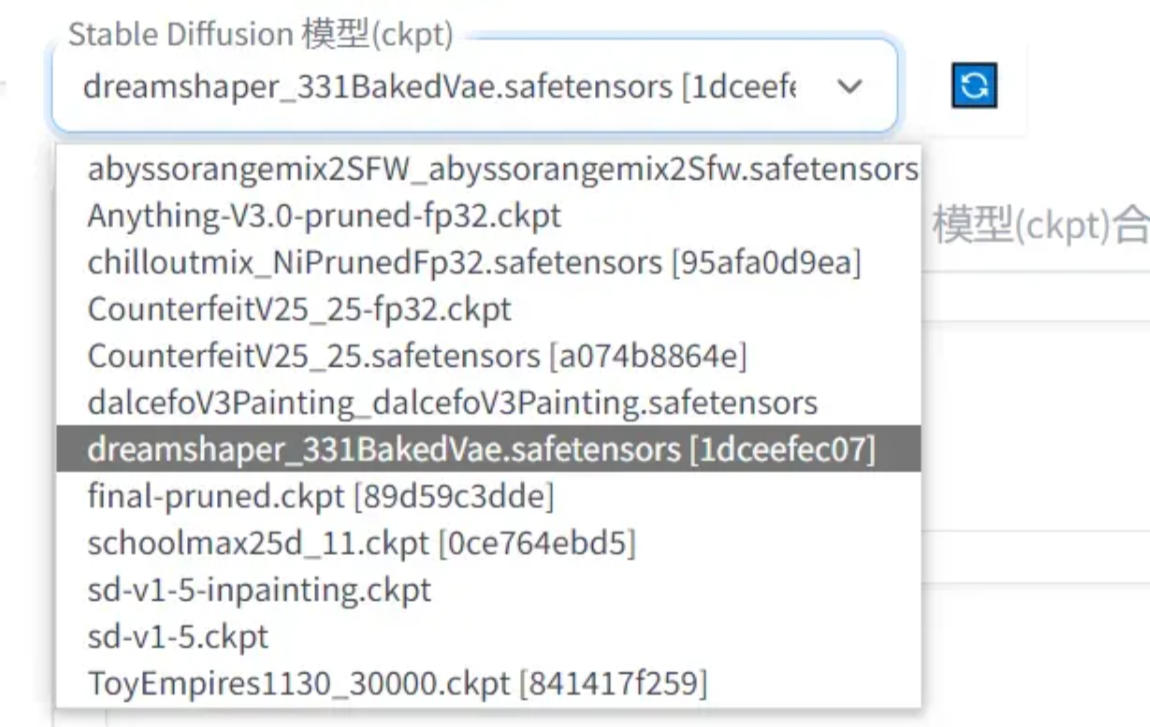

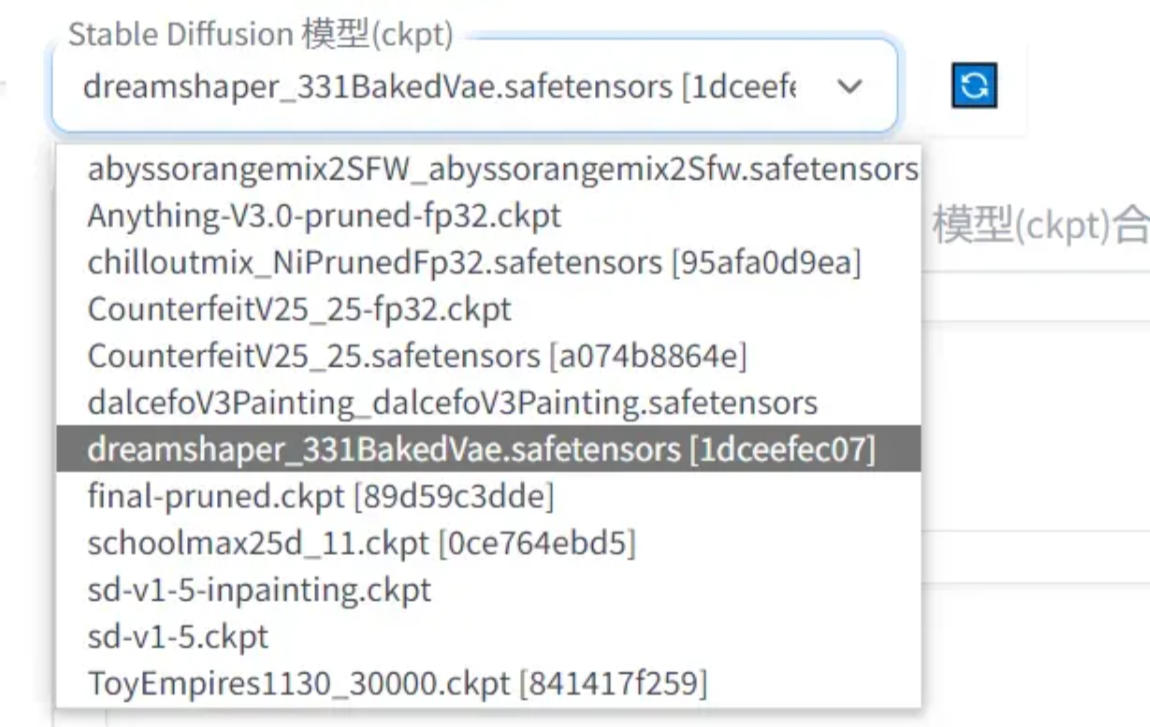

1、选择模型(Checkpoint)

模型决定整体画风。

例如:

模型决定整体画风。

例如:

- 动漫模型

- 写实模型

- 国风模型

- 赛博朋克模型

- 二次元模型

不同模型风格差异非常明显。

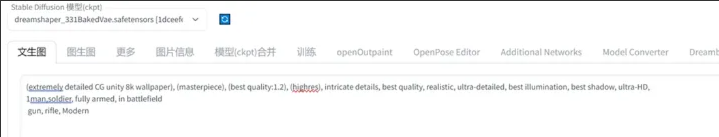

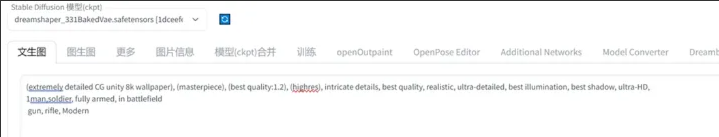

2、输入 Prompt(提示词)

Prompt 用于描述你想生成的内容。

Prompt 用于描述你想生成的内容。

masterpiece, best quality, 1girl, white hair, golden eyes, angel wings

建议使用英文关键词,兼容性更好。

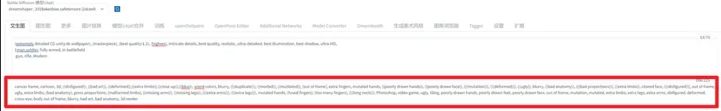

3、输入 Negative Prompt(负面提示词)

用于排除不想出现的内容。

用于排除不想出现的内容。

low quality, blurry, bad anatomy, extra fingers

合理使用负面提示词可以明显提升出图质量。

选择采样方法、采样次数、图片尺寸等参数。

4、点击生成

设置完成后点击 Generate 即可生成图片。

首次生成可能较慢,后续会快很多。

六、Stable Diffusion 参数详解

1、Sampler(采样器)

采样器决定图片的生成方式。

| 采样器 |

特点 |

| Euler |

速度快 |

| Euler a |

随机性强 |

| DPM++ |

细节优秀 |

| DDIM |

适合重绘 |

| UniPC |

速度快、稳定性高 |

新手推荐:

DPM++ 2M Karras

2、Sampling Steps(采样步数)

推荐:

20~30

步数越高,细节越多,但生成速度也越慢。

3、CFG Scale(提示词相关性)

控制 AI 对提示词的服从程度。

推荐:

7~11

过高容易导致画面失真。

4、Batch Size(批次数量)

控制一次生成多少张图片。

显存不足建议保持:

1

5、Seed(种子)

Seed 决定随机结果。

相同参数 + 相同 Seed,理论上可以复现相同图片。

6、图片尺寸

建议新手先使用:

512×512

或者:

768×768

尺寸过大会:

七、高清修复(Hires.fix)详解

高分辨率图片建议开启 Hires.fix。

它的工作流程是:

推荐参数:

| 参数 |

推荐 |

| Upscale |

1.5~2 倍 |

| Denoising |

0.3~0.7 |

| Hires Steps |

10~20 |

Denoising 越高,最终结果与原图差异越大。

八、Prompt 提示词进阶技巧

Prompt 本质上是在缩小 AI 的搜索范围。

推荐结构:

画质词 + 主体 + 风格 + 光影 + 细节

例如:

masterpiece, best quality, 1girl, cyberpunk, neon lights

Prompt 权重语法

(word):增加权重((word)):进一步增强(word:1.5):自定义权重[word]:降低权重

一般不建议权重大于 1.5。

Prompt 编写建议

- 避免语句太长

- 尽量使用英文

- 使用具体词汇

- 不要混合太多风格

- 先主体后细节

九、ControlNet 使用教程

ControlNet 是 Stable Diffusion 最强大的插件之一。

它可以通过:

精准控制 AI 出图。

常见 ControlNet 类型

| 类型 |

作用 |

| Canny |

边缘控制 |

| Depth |

深度信息 |

| OpenPose |

动作控制 |

| Scribble |

线稿生成 |

| Segmentation |

区域分割 |

多个 ControlNet 可以同时叠加使用。

十、模型分类详解

1、Checkpoint 模型

主模型,对画风影响最大。

models/Stable-diffusion

2、VAE 模型

负责画面色彩与层次。

models/VAE

3、LoRA 模型

适合强化:

models/Lora

4、Embedding 模型

通过关键词触发效果。

embeddings

十一、新手常见问题

1、为什么生成速度很慢?

2、为什么容易爆显存?

- 开启高清修复

- 使用多个 LoRA

- 多 ControlNet 叠加

- Batch Size 太大

3、为什么人物容易崩?

- Prompt 冲突

- LoRA 权重太高

- CFG 设置过高

- 模型不兼容

4、为什么别人出图比我好?

影响出图的因素很多,包括:

- 模型不同

- Prompt 不同

- Seed 不同

- VAE 不同

- LoRA 权重不同

- 采样器不同

模型决定整体画风。

例如:

模型决定整体画风。

例如:

Prompt 用于描述你想生成的内容。

Prompt 用于描述你想生成的内容。

用于排除不想出现的内容。

用于排除不想出现的内容。